С помощью этих мощных инструментов вы можете разобраться, что важно для вашего бизнеса в Интернете.

Термины веб-скрапинга используются для различных методов сбора информации и важных данных из Интернета.

Это также называется извлечением веб-данных, скрин скрапингом или веб-сбором данных.

Есть два способа сделать это:

- Вручную – вы заходите на сайт и проверяете то, что вам нужно.

- Автоматически – используете необходимые инструменты для настройки того, что вам нужно, и даете этим инструментам право работать за вас.

Чтобы получить правильный источник страниц, точно определить источник, отобразить javascript и собрать данные в удобной форме, предстоит проделать большую работу.

Вам нужно знать о программном обеспечении, тратить часы на настройку для получения нужных данных, размещать себя, беспокоиться о получении блока (хорошо, если вы используете прокси-сервер ротации IP-адресов) и т. д.

Как это помогает бизнесу?

- Вы можете получать фиды товаров, изображения, цены и другие связанные с этим сведения о товаре с различных сайтов и создавать свое хранилище данных или сайт для сравнения цен.

- Вы можете посмотреть на работу любого конкретного товара, поведение пользователя и обратную связь в соответствии с вашими требованиями.

- В эту эпоху цифровизации компании тратят много денег на управление онлайн репутацией. Таким образом, веб-скрапинг здесь также необходим.

- Для людей стало обычной практикой читать онлайн мнения и статьи.

- Отбирая результаты органического поиска, вы можете мгновенно узнать ваших SEO-конкурентов по определенному поисковому запросу. Вы можете выяснить теги заголовка и ключевые слова, которые планируют другие.

1 Scrapestack

Найдите и проанализируйте все что угодно в интернете с помощью Scrapestack.

Имея более 35 миллионов IP-адресов, вам никогда не придется беспокоиться о блокировке запроса при извлечении веб-страниц.

Когда вы делаете вызов REST-API, запросы отправляются через более чем 100 глобальных местоположений (в зависимости от плана) через надежную и масштабируемую инфраструктуру.

Вы можете попробовать его БЕСПЛАТНО для ~ 10 000 запросов с ограниченной поддержкой.

Как только вы будете удовлетворены, вы можете перейти на платный план.

Scrapestack имеет enterprise решения, и некоторые из его функций перечислены ниже.

- Рендеринг JavaScript

- HTTPS-шифрование

- Премиум прокси

- Параллельные запросы

- Нет капчи

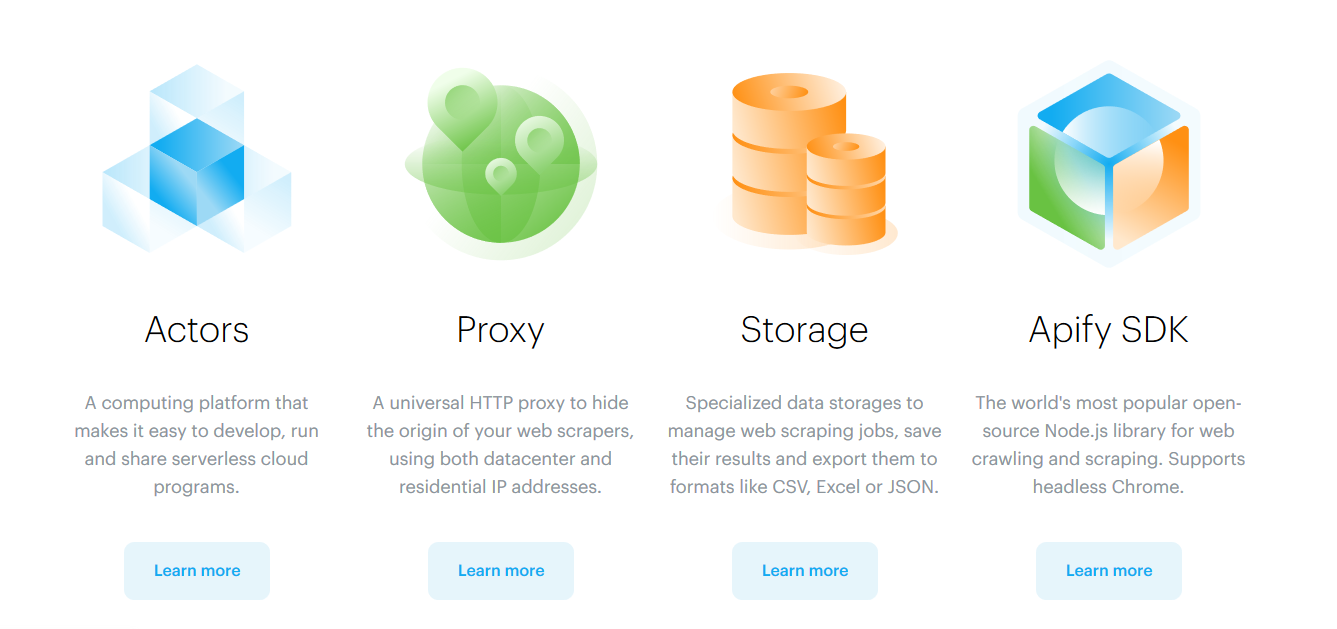

2 Apify

Apify имеет множество модулей, называемых actors, для обработки данных, превращения веб-страницы в API, преобразования данных, сканирования сайтов, запуска headless chrome и т. д.

Это самый большой источник информации, когда-либо созданный человечеством.

- Конвертировать HTML страницу в PDF

- Сканирование и извлечение данных с веб-страницы

- Скрапинг поиска Google, мест Google, Amazon, Booking, хэштега Twitter, Airbnb, Hacker News и т. д.

- Проверка содержимого веб-страницы (мониторинг искажения)

- Анализ страницы SEO

- Проверка битых ссылок

3 Web Scraper

Web Scraper представляет собой онлайн-платформу, где вы можете развертывать скрапинг, созданные и проанализированные с помощью бесплатного расширения Chrome «point-and-click ».

Используя расширение, вы создаете «карты сайта», которые определяют, как данные должны передаваться и извлекаться.

Вы можете быстро записать данные в CouchDB или загрузить их в виде файла CSV.

Особенности

- Вы можете начать работу сразу же, поскольку инструмент настолько прост, насколько это возможно, и включает в себя отличные обучающие видеоролики.

- Поддерживает тяжелые сайты JavaScript

- Его расширение – с открытым исходным кодом

- Поддерживает внешние прокси или ротацию IP

4 Scrapy

Особенности

- Глубоко настраиваемый

- Отличный пользовательский интерфейс, который позволяет вам определять все виды журналов, которые понадобятся планировщику

- Позволяет сканировать неограниченное количество страниц

- Множество полезных дополнений, которые могут развивать сканирование

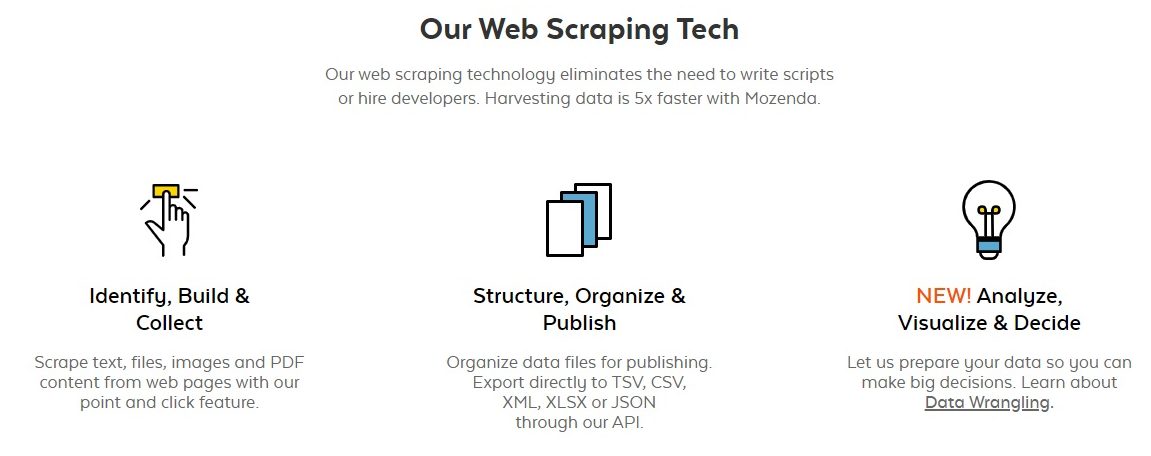

5 Mozenda

Mozenda предназначен специально для компаний, которые ищут облачную платформу самообслуживания, не нуждающуюся в дальнейшей работе.

Особенности

- Создание шаблонов для быстрого формирования рабочего процесса

- Создание последовательности заданий для автоматизации потока

- Позволяет очистить данные по региону

- Позволяет блокировть нежелательные запросы домена

6 Octoparse

Особенности

- Инструмент «Point and click» прозрачен для настройки и использования

- Поддерживает Javascript-сайты

- На локальном компьютере может работать до 10 скребков, если вам не требуется большая масштабируемость

- Включает автоматическую ротацию IP в каждом плане

7 ParseHub

8 Dexi.io

9 Diffbot

Diffbot позволяет вам настроить сканеры, которые могут индексировать веб-сайты, а затем обрабатывать их с помощью своих автоматических API-интерфейсов для извлечения определенных данных из веб-контента.

Вы также можете создать собственный экстрактор, если определенный API извлечения данных не работает для нужных вам сайтов.